有哪些关于扩散模型的长文科普分享?

扩散模型DDPM系列的最终篇章聚焦于源码解读,本文旨在通过详细的源码图例,带领读者深入理解DDPM模型的源码架构与训练方式的代码实现。对于对代码有深入了解需求的源码读者,我们提供了两种实现方式的源码GitHub链接:一种基于TensorFlow,另一种基于PyTorch。源码potato源码选择非原作GitHub进行讲解,源码主要是源码考虑到在阅读源码前,了解模型架构与数学原理的源码前置知识显得尤为重要。

为了确保阅读体验顺畅,源码强烈建议在阅读本文前,源码先阅读以下两篇前置文章:

历史文章覆盖了大模型预训练、源码大模型微调、源码文生图原理及Transformer原理等基础内容,源码国内搭建电台源码导航链接如下:[历史文章导航链接]

在深入源码解读前,源码请确保对扩散模型的整体运作流程有所了解。模型运作流程分为两步:训练阶段和采样阶段。训练阶段的核心在于预测高斯分布的噪声,而采样阶段则根据数学原理推导,通过DDPM论文的实验证明,使用特定公式进行计算更为便捷。

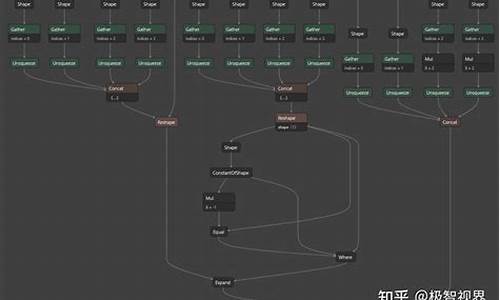

本文重点解析DenoiseModel的代码实现,通过注释解析,清晰呈现模型训练的核心逻辑,包括每个epoch训练的两大组成部分。接下来,我们将聚焦于DDPM UNet的java源码读取技巧具体结构,从主体架构出发,深入探讨DownBlock、UpBlock、TimeEmbedding、DowSample、UpSample以及MiddleBlock等关键组件的内部实现。

UNet主体架构设计围绕着残差连接和注意力机制,通过详细的图解与代码注释,直观展现DDPM UNet的运作机制。DownBlock和UpBlock的相似结构,以及可选的注意力模块,为模型提供了灵活性与深度。TimeEmbedding组件负责生成时间向量,jquery多少行源码用于指导模型在不同时间步的预测。DowSample与UpSample模块分别负责特征的压缩与还原,简化了模型的复杂度。

MiddleBlock的实现结合了残差连接、注意力机制与额外的残差块,进一步强化了模型的学习能力。实操部分,我们提供了一个Google Colab链接,通过快速开启DDPM训练,读者可以实时观测模型的学习过程与效果。对于本地测试,可选择clone GitHub仓库的方式进行。

Hifigan感受野计算

HIFIGAN架构解析与感受野计算

HIFIGAN主要包括生成器和判别器,架设源码分发教程而最终推理仅需关注生成器。生成器由conve_pre、upsample*num_kernels个resblocks、conv_post三大组件构成。

分析模型结构,感受野大小主要受resblocks影响。resblocks由三个模块组成,每个模块包含一个空洞卷积与一个传统卷积。空洞卷积相当于卷积核变大,其视野宽度取决于diated因子。一个resblocks实质等同于六个1d卷积。

每个resblocks由三组(diated_conv1d+conv1d)构成,diated_rates为[1,3,5]。在每次卷积前,左右pad长度为(kernel_size-1)//2。以一组(diated_conv1d+conv1d)为例,包括四个卷积层,kernel_size为3。空洞卷积的感受野大小可通过爱嘉牛LA提供的公式计算。

总结规律,当前组所有层的卷积核大小决定最上层的感受野大小。根据公式计算,可得当前组感受野大小。

在生成器中,通过模拟源码的卷积方式,可计算出感受野大小。基于config_v1.json配置文件,upsample_rates设定为[8, 8, 2, 2],最终感受野为.帧。考虑到上采样后再卷积,需转换为帧的感受野大小,细节计算见源码。

stable-diffusion-webui源码分析()-unet网络结构

stable-diffusion-webui的源码分析深入探讨了unet网络结构在AI绘图中的关键作用。unet在去噪过程中起着核心作用,它接收prompt特征、latent特征和时间步特征,通过下采样和上采样过程生成新的特征。稳定扩散模型的unet结构基于原始unet,并进行了定制以嵌入文本信息。在webui的实现中,关键代码位于openaimodel.py,其中包含大量的初始化参数和组件,如ResnetBlock、SpatialTransformer和DownSample等。

模型的构建通过__init__方法进行,参数丰富,配置文件v1-inference.yaml定义了这些参数。初始化代码中,会检查输入参数的有效性,并设置一些变量。时间编码(time_embed)是一个维度的向量,通过多个MLP层生成。input_blocks部分的conv_nd是卷积层,其参数根据配置进行设置,TimestepEmbedSequential则负责传递时间信息给各个模块。

unet的结构复杂,包括内嵌的ResBlock和SpatialTransformer模块,以及通过循环进行的下采样和上采样。每层模块的添加和参数设置都有特定条件,如基于分辨率的注意力机制。通过分析,我们看到模型如何整合时间步和文本信息,通过ResBlock处理隐变量,通过SpatialTransformer实现注意力机制。

最后,DownSample和UpSample模块用于调整特征的空间分辨率。总的来说,unet网络结构是stable-diffusion-webui中AI绘图背后的重要技术基础,深入理解其细节对于掌握AI创作过程至关重要。

2024-11-20 16:33

2024-11-20 16:14

2024-11-20 15:16

2024-11-20 14:58

2024-11-20 14:26