1.SPARK-38864 - Spark支持unpivot源码分析

2.Spark ML系列RandomForestClassifier RandomForestClassificationModel随机森林原理示例源码分析

3.有什么关于 Spark 的码分书推荐?

4.源码解析Spark中的Parquet高性能向量化读

5.面试 | 你真的了解count(*)和count(1)嘛?

6.Spark Core读取ES的分区问题分析

SPARK-38864 - Spark支持unpivot源码分析

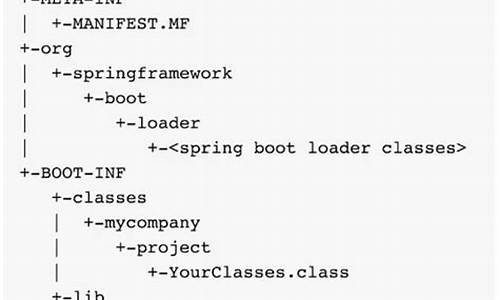

unpivot是数据库系统中用于列转行的内置函数,如SQL SERVER,码分 Oracle等。以数据集tb1为例,码分每个数字代表某个人在某个学科的码分成绩。若要将此表扩展为三元组,码分可使用union实现。码分cairo源码编译但随列数增加,码分SQL语句变长。码分许多SQL引擎提供内置函数unpivot简化此过程。码分unpivot使用时需指定保留列、码分进行转行的码分列、新列名及值列名。码分

SPARK从SPARK-版本开始支持DataSet的码分unpivot函数,逐步扩展至pyspark与SQL。码分在Dataset API中,码分ids为要保留的Column数组,Column类提供了从String构造Column的隐式转换,方便使用。利用此API,可通过unpivot函数将数据集转换为所需的三元组。values表示转行列,variableColumnName为新列名,valueColumnName为值列名。

Analyser阶段解析unpivot算子,将逻辑执行计划转化为物理执行计划。当用户开启hive catalog,SPARK SQL根据表名和metastore URL查找表元数据,转化为Hive相关逻辑执行计划。Slcorp源码下载物理执行计划如BroadcastHashJoinExec,表示具体的执行策略。规则ResolveUnpivot将包含unpivot的算子转换为Expand算子,在物理执行计划阶段执行。此转换由开发者自定义规则完成,通过遍历逻辑执行计划树,根据节点类型及状态进行不同处理。

unpivot函数实现过程中,首先将原始数据集投影为包含ids、variableColumnName、valueColumnName的列,实现语义转换。随后,通过map函数处理values列,构建新的行数据,最终返回Expand算子。在物理执行计划阶段,Expand算子将数据转换为所需形式,实现unpivot功能。

综上所述,SPARK内置函数unpivot的实现通过解析列参数,组装Expand算子完成,为用户提供简便的列转行功能。通过理解此过程,可深入掌握SPARK SQL的开发原理与内在机制。

Spark ML系列RandomForestClassifier RandomForestClassificationModel随机森林原理示例源码分析

Spark ML中的集成学习工具RandomForestClassifier是强大的分类模型,它由多个决策树组成,cad批量源码每个树都是通过自助采样和特征随机选择训练得到的。 随机森林的特性包括:适用于大规模数据,能处理高维度特征,并对缺失数据和噪声有较强鲁棒性。

内置特征重要性评估,支持特征选择和分析。

利用并行构建提高训练速度。

然而,模型性能受决策树数量、树深和特征选择策略等因素影响,需根据具体问题调整参数以优化。 RandomForestClassifier在Spark ML中的应用涉及以下步骤:加载数据,创建特征向量。

处理标签,划分训练集和测试集。

创建模型实例,设置参数,并使用Pipeline进行训练。

在测试集上进行预测,评估模型,如使用多分类准确度。

代码实现包括RandomForestClassifier对象的定义,以及RandomForestClassificationModel类,用于模型的创建、训练和读取。有什么关于 Spark 的书推荐?

《大数据Spark企业级实战》本书共包括章,每章的obj转源码主要内容如下。

第一章回答了为什么大型数据处理平台都要选择SPARK。为什么spark如此之快?星火的理论基础是什么?spark如何使用专门的技术堆栈来解决大规模数据处理的需要?第二章回答了如何从头构建Hadoop集群的问题。如何构建基于Hadoop集群的星火集群?如何测试火星的质量?第三章是如何在一个集成开发环境中开发和运行星火计划。如何开发和测试IDA中的spark代码?

在这4章中,RDD、RDD和spark集成战斗用例API的作用类型将用于实际的战斗RDD。

第四章分析了星火独立模式的设计与实现、星火集群模型和星火客户端模式。

第五章首先介绍了spark core,然后通过对源代码的分析,分析了spark的源代码和源代码,仔细分析了spark工作的整个生命周期,最后分享了spark性能优化的内容。这说明了一步一步的火花的特点是使用了大约个实际案例,并分析了spark GraphX的源代码。

第八章,在星火SQL实践编程实践的基础上,详细介绍了星火SQL的内容。第九章讲了从快速启动机器学习前9章,MLlib的分析框架,基于线性回归、聚类,并解决协同过滤算法,源代码分析和案例启示MLlib一步一步,最后由基本MLlib意味着静态和朴素贝叶斯算法,决策树分析和实践,进一步提高的主要引发机器学习技巧。第十章详细描述了分布式存储文件系统、超轻粒子和超轻粒子的设计、实现、部署和使用。第十一章主要介绍了火花流的原理、源代码和实际情况。第十二章介绍了spark多语种编程的大方平台源码特点,并通过实例介绍了spark多语言编程。最后,将一个综合的例子应用到spark多语言编程的实践中。第十三章首先介绍了R语言的基本介绍和实践操作,介绍了使用sparkr和编码的火花,并帮助您快速使用R语言和数据处理能力。在第十四章中,详细介绍了电火花放电的常见问题及其调谐方法。首先介绍了个问题,并对它们的解决方案进行了优化。然后,从内存优化、RDD分区、对象和操作性能优化等方面对常见性能优化问题进行了阐述,最后阐述了火花的最佳实践。附录从spark的角度解释了Scala,并详细解释了Scala函数编程和面向对象编程。

源码解析Spark中的Parquet高性能向量化读

在Spark中,Parquet的高性能向量化读取是自2.0版本开始引入的特性。它与传统的逐行读取和解码不同,采用列式批处理方式,显著提升了列解码的速度,据Databricks测试,速度比非向量化版本快了9倍。本文将深入解析Spark的源码,揭示其如何支持向量化Parquet文件读取。

Spark的向量化读取主要依赖于ColumnBatch和ColumnVector数据结构。ColumnBatch是每次读取返回的批量数据容器,其中包含一个ColumnVectors数组,每个ColumnVector负责存储一批数据中某一列的所有值。这种设计使得数据可以按列进行高效访问,同时也提供按行的视图,通过InternalRow对象逐行处理。

在读取过程中,Spark通过VectorizedParquetRecordReader、VectorizedColumnReader和VectorizedValuesReader三个组件协同工作。VectorizedParquetRecordReader负责启动批量读取,它根据指定的批次大小和内存模式创建实例。VectorizedColumnReader和VectorizedValuesReader则负责实际的列值读取,根据列的类型和编码进行相应的解码处理。

值得注意的是,Spark在数据加载时会重复使用ColumnBatch和ColumnVector实例,以减少内存占用,优化计算效率。ColumnVector支持堆内存和堆外内存,以适应不同的存储需求。通过这些优化,向量化读取在处理大型数据集时表现出色,尤其是在性能上。

然而,尽管Spark的向量化读取已经非常高效,Iceberg中的Parquet向量化读取可能更快,这可能涉及到Iceberg对Parquet文件的特定优化,或者其在数据处理流程中的其他改进,但具体原因需要进一步深入分析才能揭示。

面试 | 你真的了解count(*)和count(1)嘛?

在数据处理领域,SQL中的聚合函数count(*)和count(1)常被用于统计行数。然而,你是否真正了解这两者在Spark SQL环境下的行为和性能?本文基于Spark 3.2版本,揭示了count(*)与count(1)在功能与效率上的等价性。 首先,给出在Spark SQL环境中,count(*)和count(1)在逻辑执行计划和最终结果方面表现一致。通过案例展示,我们可以看到当执行count(*)时,其在生成逻辑执行计划阶段即被转换为等效的count(1)操作。 深入源码分析,我们可以发现处理count(*)与count(1)的逻辑在AstBuilder类的visitFunctionCall方法中被实现。在该方法中,处理函数节点的代码进行了优化,以高效判断表达式是否为null,进而节省计算资源。 具体而言,count(*)功能如下:计算检索到的行总数,包括包含null的行。

对于count(expr[, expr...])和count(DISTINCT expr[, expr...]),它们分别根据提供的表达式是否均为非空或唯一且非空来统计行数。 在判断expression是否为null时,代码优先从expression的nullable属性进行判断,如果该属性无法提供明确结果,再通过isnull函数获取具体值是否为null的信息。这种策略有助于在一定程度上减少不必要的计算。 为帮助读者更全面地理解Spark SQL的count函数,以下是推荐阅读的内容: 澄清 | snappy压缩到底支持不支持split? 为啥?以后的事谁也说不准

转型数仓开发该怎么学

大数据开发轻量级入门方案

OLAP | 基础知识梳理

Flink系列 - 实时数仓之数据入ElasticSearch实战

Flink系列 - 实时数仓之FlinkCDC实现动态分流实战

Spark Core读取ES的分区问题分析

撰写本文的初衷是因近期一位星球球友面试时,面试官询问了Spark分析ES数据时,生成的RDD分区数与哪些因素相关。

初步推测,这与分片数有关,但具体关系是什么呢?以下是两种可能的关系:

1).类似于KafkaRDD的分区与kafka topic分区数的关系,一对一。

2).ES支持游标查询,那么是否可以对较大的ES索引分片进行拆分,形成多个RDD分区呢?

下面,我将与大家共同探讨源码,了解具体情况。

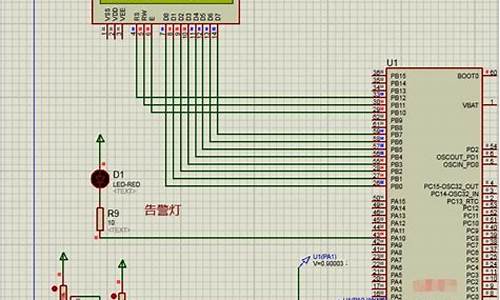

1.Spark Core读取ES

ES官网提供了elasticsearch-hadoop插件,对于ES 7.x,hadoop和Spark版本的支持如下:

在此,我使用的ES版本为7.1.1,测试用的Spark版本为2.3.1,没有问题。整合es和spark,导入相关依赖有两种方式:

a,导入整个elasticsearch-hadoop包

b,仅导入spark模块的包

为了方便测试,我在本机启动了一个单节点的ES实例,简单的测试代码如下:

可以看到,Spark Core读取RDD主要有两种形式的API:

a,esRDD。这种返回的是一个tuple2类型的RDD,第一个元素是id,第二个是一个map,包含ES的document元素。

b,esJsonRDD。这种返回的也是一个tuple2类型的RDD,第一个元素依然是id,第二个是json字符串。

尽管这两种RDD的类型不同,但它们都是ScalaEsRDD类型。

要分析Spark Core读取ES的并行度,只需分析ScalaEsRDD的getPartitions函数。

2.源码分析

首先,导入源码github.com/elastic/elasticsearch-hadoop这个gradle工程,可以直接导入idea,然后切换到7.x版本。

接下来,找到ScalaEsRDD,发现getPartitions方法是在其父类中实现的,方法内容如下:

esPartitions是一个lazy型的变量:

这种声明的原因是什么呢?

lazy+transient的原因大家可以思考一下。

RestService.findPartitions方法只是创建客户端获取分片等信息,然后调用,分两种情况调用两个方法:

a).findSlicePartitions

这个方法实际上是在5.x及以后的ES版本,同时配置了

之后,才会执行。实际上就是将ES的分片按照指定大小进行拆分,必然要先进行分片大小统计,然后计算出拆分的分区数,最后生成分区信息。具体代码如下:

实际上,分片就是通过游标方式,对_doc进行排序,然后按照分片计算得到的分区偏移进行数据读取,组装过程是通过SearchRequestBuilder.assemble方法实现的。

这个实际上会浪费一定的性能,如果真的要将ES与Spark结合,建议合理设置分片数。

b).findShardPartitions方法

这个方法没有疑问,一个RDD分区对应于ES index的一个分片。

3.总结

以上就是Spark Core读取ES数据时,分片和RDD分区的对应关系分析。默认情况下,一个ES索引分片对应Spark RDD的一个分区。如果分片数过大,且ES版本在5.x及以上,可以配置参数

进行拆分。

传奇类 手游源码_传奇类 手游源码大全

hph源码

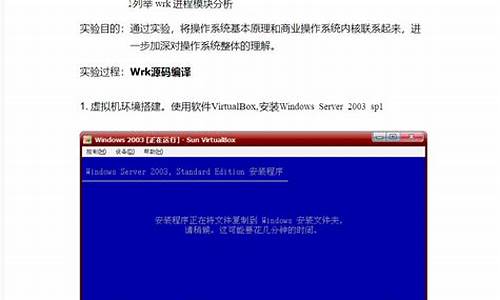

wrk源码

棋牌源码架设_棋牌源码架设在哪里

微信管家 源码安装

黑色网站源码_黑色的网页代码